AI编译框架分为两种运行模式,分别是动态图模式以及静态图模式。MindSpore默认情况下是以动态图模式运行,但也支持手工切换为静态图模式。两种运行模式的详细介绍如下:

1、动态图模式

动态图的特点是计算图的构建和计算同时发生(Define by run),其符合Python的解释执行方式,在计算图中定义一个Tensor时,其值就已经被计算且确定,因此在调试模型时较为方便,能够实时得到中间结果的值,但由于所有节点都需要被保存,导致难以对整个计算图进行优化。

在MindSpore中,动态图模式又被称为PyNative模式。由于动态图的解释执行特性,在脚本开发和网络流程调试过程中,推荐使用动态图模式进行调试。 如需要手动控制框架采用PyNative模式,可以通过以下代码进行网络构建:

mindspore.set_context(**kwargs)

设置运行环境的context。

在运行程序之前,应配置context。如果没有配置,默认情况下将根据设备目标进行自动设置。

【参数】

**kwargs:详细配置项看链接MindSpore

import numpy as np

import mindspore as ms

from mindspore import nn, Tensor

ms.set_context(mode=ms.PYNATIVE_MODE) # 使用set_context进行动态图模式的配置

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

model = Network()

input = Tensor(np.ones([64, 1, 28, 28]).astype(np.float32))

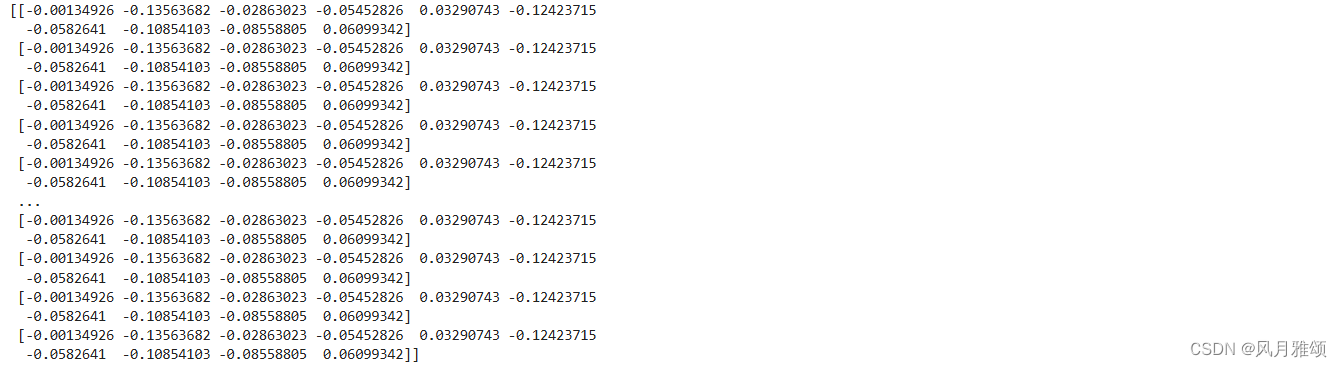

output = model(input)

print(output)

2、静态图模式

相较于动态图而言,静态图的特点是将计算图的构建和实际计算分开(Define and run)。有关静态图模式的运行原理,可以参考静态图语法支持。

在MindSpore中,静态图模式又被称为Graph模式,在Graph模式下,基于图优化、计算图整图下沉等技术,编译器可以针对图进行全局的优化,获得较好的性能,因此比较适合网络固定且需要高性能的场景。

如需要手动控制框架采用静态图模式,可以通过以下代码进行网络构建:

import numpy as np

import mindspore as ms

from mindspore import nn, Tensor

ms.set_context(mode=ms.GRAPH_MODE) # 使用set_context进行运行静态图模式的配置

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

model = Network()

input = Tensor(np.ones([64, 1, 28, 28]).astype(np.float32))

output = model(input)

print(output)

对比动态图和静态图构建的代码,我们可以发现,区别在于设置运行环境的context不同。

动态图为ms.set_context(mode=ms.PYNATIVE_MODE) # 使用set_context进行动态图模式的配置

静态图为ms.set_context(mode=ms.GRAPH_MODE) # 使用set_context进行静态图模式的配置。

2.1 静态图模式的使用场景

MindSpore编译器重点面向Tensor数据的计算以及其微分处理。因此使用MindSpore API以及基于Tensor对象的操作更适合使用静态图编译优化。其他操作虽然可以部分入图编译,但实际优化作用有限。另外,静态图模式先编译后执行的模式导致其存在编译耗时。因此,如果函数无需反复执行,那么使用静态图加速也可能没有价值。

有关使用静态图来进行网络编译的示例,请参考网络构建。

2.2 静态图模式开启方式

通常情况下,由于动态图的灵活性,我们会选择使用PyNative模式来进行自由的神经网络构建,以实现模型的创新和优化。但是当需要进行性能加速时,我们需要对神经网络部分或整体进行加速。MindSpore提供了两种切换为图模式的方式,分别是基于装饰器的开启方式以及基于全局context的开启方式。

2.2.1 基于装饰器的开启方式

MindSpore提供了jit装饰器,可以通过修饰Python函数或者Python类的成员函数使其被编译成计算图,通过图优化等技术提高运行速度。此时我们可以简单的对想要进行性能优化的模块进行图编译加速,而模型其他部分,仍旧使用解释执行方式,不丢失动态图的灵活性。无论全局context是设置成静态图模式还是动态图模式,被jit修饰的部分始终会以静态图模式进行运行。

在需要对Tensor的某些运算进行编译加速时,可以在其定义的函数上使用jit修饰器,在调用该函数时,该模块自动被编译为静态图。需要注意的是,jit装饰器只能用来修饰函数,无法对类进行修饰。

mindspore.jit(fn=None, mode='PSJit', input_signature=None, hash_args=None, jit_config=None, compile_once=False)

将Python函数编译为一张可调用的MindSpore图。MindSpore可以在运行时对图进行优化。

【参数】

-

fn (Function) - 要编译成图的Python函数。默认值:

None。 -

mode (str) - 使用jit的类型,可选值有

"PSJit"和"PIJit"。默认值:"PSJit"。-

PSJit :MindSpore 静态图模式。

-

PIJit :MindSpore 动态图模式。

-

-

input_signature (Tensor) - 用于表示输入参数的Tensor。Tensor的shape和dtype将作为函数的输入shape和dtype。默认值:

None。 -

hash_args (Union[Object, List or Tuple of Objects]) - fn 里面用到的自由变量,比如外部函数或类对象,再次调用时若 hash_args 出现变化会触发重新编译。默认值:

None。 -

jit_config (JitConfig) - 编译时所使用的JitConfig配置项,详细可参考 mindspore.JitConfig。默认值:

None。 -

compile_once (bool) -

True: 函数多次重新创建只编译一次,如果函数里面的自由变量有变化,设置True是有正确性风险;False: 函数重新创建会触发重新编译。默认值:False。

返回:

函数,如果 fn 不是None,则返回一个已经将输入 fn 编译成图的可执行函数;如果 fn 为None,则返回一个装饰器。当这个装饰器使用单个 fn 参数进行调用时,等价于 fn 不是None的场景。

jit的使用示例如下:

import numpy as np

import mindspore as ms

from mindspore import nn, Tensor

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

input = Tensor(np.ones([64, 1, 28, 28]).astype(np.float32))

@ms.jit # 使用ms.jit装饰器,使被装饰的函数以静态图模式运行

def run(x):

model = Network()

return model(x)

output = run(input)

print(output)2.2.2 函数变换调用

除使用修饰器外,也可使用函数变换方式调用jit方法,示例如下:

import numpy as np

import mindspore as ms

from mindspore import nn, Tensor

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

input = Tensor(np.ones([64, 1, 28, 28]).astype(np.float32))

def run(x):

model = Network()

return model(x)

run_with_jit = ms.jit(run) # 通过调用jit将函数转换为以静态图方式执行

output = run(input)

print(output)2.2.3 construct方法上使用jit修饰器

当我们需要对神经网络的某部分进行加速时,可以直接在construct方法上使用jit修饰器,在调用实例化对象时,该模块自动被编译为静态图。示例如下:

import numpy as np

import mindspore as ms

from mindspore import nn, Tensor

class Network(nn.Cell):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.dense_relu_sequential = nn.SequentialCell(

nn.Dense(28*28, 512),

nn.ReLU(),

nn.Dense(512, 512),

nn.ReLU(),

nn.Dense(512, 10)

)

@ms.jit # 使用ms.jit装饰器,使被装饰的函数以静态图模式运行

def construct(self, x):

x = self.flatten(x)

logits = self.dense_relu_sequential(x)

return logits

input = Tensor(np.ones([64, 1, 28, 28]).astype(np.float32))

model = Network()

output = model(input)

print(output)3、其他

3.1 静态图的语法约束

在Graph模式下,Python代码并不是由Python解释器去执行,而是将代码编译成静态计算图,然后执行静态计算图。因此,编译器无法支持全量的Python语法。MindSpore的静态图编译器维护了Python常用语法子集,以支持神经网络的构建及训练。详情可参考静态图语法支持。

3.2 JitConfig配置选项

在图模式下,可以通过使用JitConfig配置选项来一定程度的自定义编译流程,目前JitConfig支持的配置参数如下:

- jit_level: 用于控制优化等级。

- exec_mode: 用于控制模型执行方式。

- jit_syntax_level: 设置静态图语法支持级别,详细介绍请见静态图语法支持。

3.3 静态图高级编程技巧

使用静态图高级编程技巧可以有效地提高编译效率以及执行效率,并可以使程序运行的更加稳定。详情可参考静态图高级编程技巧。

【打卡】